Architektur-First: Warum RAG und sichere Schnittstellen die Basis Ihrer KI-Strategie sind

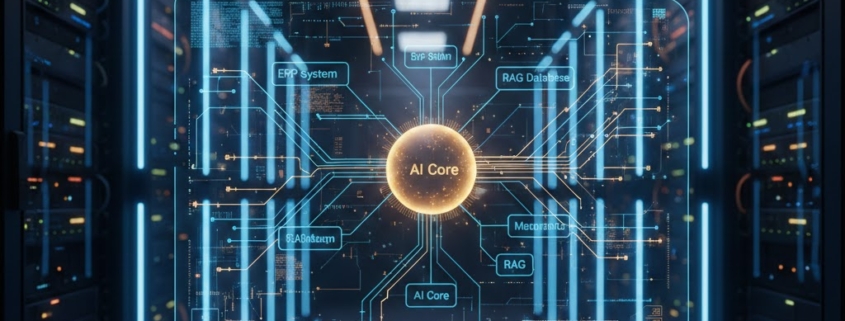

Für CTOs ist die Frage heute nicht mehr, ob Generative AI implementiert wird, sondern wie dies geschieht, ohne die Integrität der Systemlandschaft zu gefährden. Während die Business-Seite auf schnelle Feature-Releases drängt, liegt die technologische Verantwortung in der Schaffung einer Architektur, die LLMs (Large Language Models) kontrollierbar macht. Die Herausforderung: Wie nutzen wir die Reasoning-Fähigkeiten moderner Modelle, ohne unser „Knowledge Capital“ – also unser geistiges Eigentum und sensible ERP-Daten – unkontrolliert in externe Blackboxes zu speisen? Die Antwort liegt in einer hybriden Strategie aus RAG, gehärteten Schnittstellen und einem kompromisslosen Fokus auf Data Security.

RAG vs. Fine-Tuning: Die technologische Entscheidung für Datensouveränität

In der frühen Phase des KI-Hypes wurde oft das Fine-Tuning von Modellen als Königsweg propagiert. Aus CTO-Sicht ist dies jedoch oft ineffizient, teuer und riskant, da Daten im Modell „verbacken“ werden. Hier setzt RAG (Retrieval-Augmented Generation) an.

Das Konzept von RAG trennt die „Logik“ (das LLM) strikt vom „Wissen“ (Ihre Datenbank). Bei einer Anfrage sucht ein Retriever-System zuerst in Ihren internen Vektordatenbanken nach relevanten Kontexten und übergibt nur diese spezifischen Snippets zusammen mit der Frage an das LLM.

Ein wesentlicher Sicherheits-Vorteil besteht darin, dass Ihre Daten nicht Teil des Modell-Gewichts werden. Sie behalten die volle Kontrolle darüber, welcher Nutzer auf welche Dokumente zugreifen darf, indem Sie bestehende Access Control Lists (ACLs) auf die Vektordatenbank spiegeln. Da das Modell instruiert wird, nur auf Basis des mitgelieferten Kontexts zu antworten, sinkt zudem die Rate an Halluzinationen drastisch – ein kritischer Faktor bei technischen Dokumentationen oder Finanzdaten.

Die unterschätzte Komponente: ERP-Schnittstellen und Data Fabric

Ein LLM ist nur so wertvoll wie der Kontext, den es verarbeiten kann. Die wertvollsten Daten liegen meist tief im ERP-System (SAP, Microsoft Dynamics, etc.). Hier entstehen oft die gefährlichsten Security-Gaps, wenn die Integration überstürzt erfolgt.

Klassische REST-APIs reichen für KI-Agenten oft nicht aus. Wir benötigen eine Abstraktionsschicht, die sicherstellt, dass die KI nicht direkt auf Datenbankebene operiert, sondern über validierte Business-Logik-Schnittstellen. Dies verhindert, dass die KI durch geschicktes Prompting (Prompt Injection) unautorisierte Schreibvorgänge im ERP auslöst.

Besonders bei geistigem Eigentum (IP) wie Konstruktionszeichnungen, Rezepturen oder spezifischen Prozess-Workflows ist Vorsicht geboten. Diese Daten sind Ihr Differenzierungsmerkmal. Eine Fehlkonfiguration im Prompt-Engineering oder ein unsicherer API-Endpunkt könnte dazu führen, dass geschütztes Wissen über Cache-Mechanismen des LLM-Anbieters abfließt. Implementieren Sie daher zwingend „Data Guardrails“: Jede Anfrage an ein externes Modell muss automatisiert auf PII (Personally Identifiable Information) und geschäftskritische Schlüsselwörter gescannt werden, bevor sie das Haus verlässt.

Chancen und technologische Risiken der Roadmap

Die Chancen für Ihre IT-Infrastruktur sind immens. Eine gut implementierte RAG-Architektur bietet hohe Agilität und Zugriff auf Echtzeitdaten, ohne die massiven Kosten eines Re-Trainings. Sie schaffen ein „Sprachinterface“ für komplexe Unternehmensdaten, das die Produktivität Ihrer Teams skaliert.

Dem gegenüber stehen technologische Risiken wie die Komplexität in der Vektorisierung (Embedding-Drift) und potenzielle Latenzzeiten durch den zusätzlichen Retrieval-Step. Zudem muss die Infrastruktur gegen neuartige Angriffsvektoren wie Natural Language SQL-Injections gehärtet werden. Wer maximale Sicherheit benötigt, sollte zudem die Evaluation von On-Premise oder Private Cloud LLMs in Betracht ziehen, um die vollständige Datenhoheit zu behalten, auch wenn dies höhere Anforderungen an die Hardware-Ressourcen (GPUs) stellt.

Fazit

Die Einführung von KI im Unternehmen ist für uns CTOs primär eine Integrations- und Sicherheitsaufgabe. Wer den Fehler macht, LLMs als isolierte Chatbots zu betrachten, riskiert Schatten-IT und Datenabfluss. Eine robuste Architektur muss auf RAG basieren, um Wissen von Logik zu trennen, und benötigt tief integrierte, aber strikt gesicherte Schnittstellen zu den Core-Systemen. Wahre technologische Exzellenz zeigt sich darin, KI so zu orchestrieren, dass sie den Wert des geistigen Eigentums steigert, anstatt ihn durch mangelnde Security zu verwässern.

Hinterlasse einen Kommentar

An der Diskussion beteiligen?Hinterlasse uns deinen Kommentar!